Negli ultimi anni continuano a fiorire podcast, libri, eventi, app e titoli di giornali sull’ansia e su una presunta generazione ansiosa a dimostrare la progressiva brandizzazione della salute mentale basata su un martellamento multimodale. I prodotti sono orientati a una comunità consumatrice omogenea alla quale vengono fornite soluzioni e messaggi rassicuranti che la rendono più propensa a spendere per migliorare il proprio benessere. Il target di clientela è medio alto.

L’ansia rappresenta solo un esempio di questa tendenza e proprio per le sue caratteristiche può condurre al successo un marchio (intendendo sia un’azienda, sia una categoria, sia una persona esperta con un proprio seguito). Indurre a valutare in modo erroneo una situazione e a vedere una minaccia anche dove questa non trova riscontro nella realtà fattuale è una strategia (ad esempio, dare falsi dati sui disturbi mentali e sulle loro cause) per accrescere le preoccupazioni irrazionali; rassicurare attraverso soluzioni illusorie (contenute nel proprio libro, video, sito, pagina social, ecc.) fornisce un momentaneo sollievo che porterà a richiedere ulteriori rassicurazioni e quindi a consumare altri prodotti all’imbattersi in ulteriori allarmi (che puntuali arrivano). A queste strategie autopromozionali se ne aggiungono altre due che ampliano il pubblico.

Se è vero che ogni persona in determinati momenti di vita può sperimentare ansia, non tutte le persone presentano i sintomi che definiscono un disturbo di ansia (un insieme di disturbi di diversa gravità). La banalizzazione e la minimizzazione delle manifestazioni sintomatiche di un disturbo d’ansia consistono, ad esempio, nell’attribuirle a un’intera generazione o nello sminuirle rispetto a condizioni ritenute più gravi e debilitanti (“c’è chi sta peggio”). Facendo leva sulla comune esperienza di ansia (non di un disturbo di ansia) si aggancia il pubblico.

Tuttavia, la minimizzazione va ad incrementare il senso di colpa e di vergogna delle singole persone che sono immobilizzate da un disturbo. Inoltre, l’estensione a un’intera generazione di una narrazione semplificata di malattia va ad aggiungere un carattere definitorio, offrendo una lente attraverso la quale quella generazione viene vista mentre è distorta la sua eterogeneità. Si arriva a una definizione semplificata che stigmatizza chi ne fa parte e diventa strumentale a spiegare impropriamente fenomeni sociali o a essere associata a cause pretestuose come l’impatto delle nuove tecnologie, allo scopo di giustificare spinte ideologiche regolatorie. I benefici per il marketing, dunque, comportano dei costi in termini di stigma e sofferenza per le persone che affrontano quotidianamente le conseguenze di una condizione psicopatologica. Ma non è questo pubblico ristretto il target.

Una campagna promozionale per un prodotto/servizio/persona che sfrutta il tema della salute mentale ha caratteristiche proprie e non va confusa con una campagna di sensibilizzazione sulla salute mentale (meglio su condizioni specifiche) che è rivolta a modificare dei comportamenti per il bene pubblico e neppure va confusa con il marketing emozionale che fa appello alla paura per migliorare o proteggere la vita delle persone e dell’ambiente in cui vivono.

Non ci sono avvertenze, al momento, che ci permettono di sapere quando siamo di fronte a un messaggio promozionale orientato a scopi autopromozionali e allora occorre ingegnarsi a cogliere i segnali di: procurata preoccupazione irrazionale, rassicurazione, banalizzazione e minimizzazione.

In particolare, ci troviamo di fronte a una comunicazione autopromozionale (persona, categoria o azienda) che fa leva sulla ‘salute mentale’ ed è diffusa tramite articoli, interviste, post sui social ecc., se:

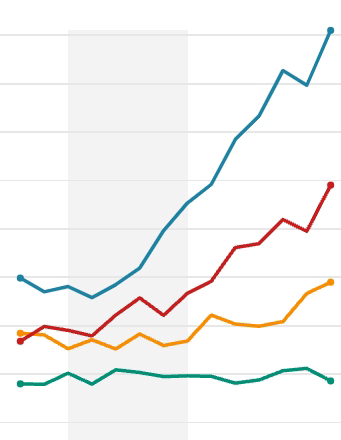

- i toni sono allarmistici (con il ricorso a percentuali e a grafici di sicuro effetto quanto improbabile fondamento), ad esempio, “è allarme”, “epidemia di ansia”;

- si attribuisce inappropriatamente a un ampio gruppo di persone un malessere omogeneo e mal definito (ad esempio, “una generazione ansiosa”, “i giovani d’oggi sono fragili”);

- si semplificano le cause (ad esempio, “i social media causano disturbi mentali”, “adolescenti dipendenti dallo smartphone”) e le soluzioni (vietare i social a un'età arbitraria, vietare gli smartphone in classe).

Il prodotto/servizio da acquistare può essere svelato nella prima fase della promozione oppure nelle fasi successive, dopo la fidelizzazione della clientela con l'appello alla paura. Il pubblico fidelizzato diventa poi la base per legittimare una comunicazione ingannevole.

L'appello all'opinione popolare, la fallacia per cui un'ipotesi (ad esempio, sui danni dei social media a adolescenti) è ritenuta corretta solo perché è sostenuta da un ampio gruppo di persone viene usata ad esempio in questa frase da Jonathan Haidt:

"Ecco una buona critica del mio recente lavoro. [Autore] nota debolezze in alcuni degli studi che cito. Tuttavia, penso che gli studi correlazionali, longitudinali e sperimentali in linea con ciò che dicono gli adolescenti e che vedono i genitori contino molto".

I dati artefatti (come ha scritto incautamente un giornalista "studi su studi su studi") servono quindi a fidelizzare il pubblico così che il pubblico diventi la garanzia del valore del proprio messaggio anche contro le critiche nel metodo e nel merito.

Il pubblico va mantenuto e questo richiede impegno e nuovi prodotti: ecco che ricomincia il ciclo autopromozionale.

In questi giorni esce l'ultima 'fatica' di Haidt [The Anxious Generation] e il suo pubblico è elettrizzato, a cominciare dalle redazioni dei giornali.

Gli esempi nostrani comunque non mancano.